Introdução

Para muitas organizações, a Inteligência Artificial está a tornar-se integrada na tomada de decisão central, nas experiências dos clientes e nos processos operacionais. No entanto, enquanto o investimento em IA continua a acelerar, muitos líderes continuam a lutar com uma questão fundamental:

Como sabemos se a nossa transformação em IA é realmente bem-sucedida — e responsável?

As métricas tradicionais de transformação digital focam-se fortemente em marcos de entrega, poupança de custos ou ganhos de produtividade. A IA, no entanto, introduz novos desafios: resultados probabilísticos, modelos em evolução, risco ético, escrutínio regulatório e profunda mudança sociotécnica. Medir o sucesso apenas através de KPIs financeiros ou operacionais já não é suficiente.

Este artigo propõe uma resposta mais robusta: a transformação bem-sucedida da IA deve ser medida tanto pelo desempenho como pela responsabilidade. Organizações que não o fazem podem escalar sistemas frágeis, pouco fiáveis ou desalinhados com as expectativas sociais e regulatórias.

Por que a transformação da IA exige novas métricas

Ao contrário dos sistemas de TI deterministas, os sistemas de IA aprendem com os dados, adaptam-se ao longo do tempo e influenciam as decisões humanas. Isto cria três implicações para a medição:

Os resultados são probabilísticos, não garantidos

Os riscos evoluem após a implantação, não apenas no lançamento

Valor e prejuízo podem escalar simultaneamente

Como destacado em pesquisas do Fórum Económico Mundial e do MIT Sloan, as organizações que têm sucesso com IA tratam a governação e a ética como facilitadoras de escala, e não como restrições à inovação.

Isto requer ir além de indicadores de sucesso restritos, em direção a um scorecard equilibrado para a transformação responsável da IA.

As Cinco Dimensões do Sucesso da IA Responsável

Com base nas suas notas de prontidão e capacidade, o sucesso da transformação da IA pode ser avaliado em cinco dimensões interdependentes.

1. Métricas de Alinhamento Estratégico

Estamos a resolver os problemas certos — de forma responsável?

As iniciativas de IA frequentemente falham não devido a modelos deficientes, mas devido à fraca adequação estratégica. A IA responsável começa com a seleção do problema, não pela seleção do modelo.

Métricas-chave incluem:

- Percentagem de casos de uso de IA explicitamente ligados a objetivos estratégicos

- Presença de hipóteses documentadas de valor em IA (negócio + impacto social)

- Patrocínio executivo e continuidade orçamental em iniciativas de IA

- Alinhamento com o apetite e os valores de risco das empresas

2. Métricas de Prontidão e Integridade de Dados

Os dados são adequados tanto para desempenho como para justiça?

Os dados são o ponto de falha mais comum na transformação da IA — e o risco ético mais subestimado.

Métricas operacionais:

- Completude, precisão e atualidade dos dados

- Redução de conjuntos de dados isolados ou duplicados

- Estabilidade e automação dos pipelines de dados

Métricas de IA responsável:

- Cobertura de auditorias de viés e representatividade

- Percentagem de conjuntos de dados com procedência e consentimento documentados

- Controlos de governação para dados sensíveis ou regulados

As organizações de alto desempenho tratam a governação de dados como infraestrutura contínua, e não como uma caixa de verificação de conformidade.

Isto está em estreita linha com as expectativas emergentes ao abrigo da Lei da IA da União Europeia, onde a qualidade e a rastreabilidade dos dados são controlos centrais de risco.

Um sinal crítico de governação é se os investimentos em IA são priorizados com base no impacto no negócio e no risco ético, em vez de na novidade técnica.

Indicador de IA responsável:

Sistemas de IA de alto impacto e alto risco recebem mais supervisão — e não menos urgência.

3. Ciclo de Vida do Modelo e Métricas de Supervisão

Conseguimos ver, controlar e corrigir os nossos sistemas de IA ao longo do tempo?

O sucesso da IA não é implementação — é desempenho sustentado em condições mutáveis.

Métricas-chave do ciclo de vida incluem:

Deriva de desempenho do modelo ao longo do tempo

Frequência dos ciclos de reeducação e validação

Taxas de sobreposição ou escalada humana

Tempo para detetar e corrigir saídas prejudiciais ou degradadas

Métricas de IA responsável:

Limiares de explicabilidade para decisões de alto impacto

Auditabilidade das decisões e registos do modelo

Responsabilidade clara para a responsabilidade pós-implantação

Organizações que não conseguem monitorizar modelos em produção de forma eficaz não os podem governar eticamente.

4. Pessoas, Competências e Métricas Culturais

As pessoas confiam, compreendem e melhoram o sistema?

A transformação da IA é, em última análise, uma transformação da força de trabalho. A resistência cultural, o medo ou o mal-entendido podem minar até sistemas tecnicamente excelentes.

Métricas de capacidade:

Níveis de literacia em IA em funções não técnicas

Participação transversal em projetos de IA

Adoção de ferramentas de IA na tomada de decisões diárias

Indicadores de IA responsável:

Confiança dos colaboradores em resultados desafiantes de IA

Transparência sobre como a IA afeta os papéis e decisões

Existência de canais seguros de feedback e escalonamento

Como referido nas orientações da OCDE, a IA responsável requer agência humana, não automação cega.

5. Métricas de Governação, Confiança e Responsabilidade

Conseguirá a organização justificar as suas decisões de IA — interna e externamente?

É aqui que muitas métricas de transformação param — e onde começa a IA responsável.

As métricas de governação incluem:

Classificação clara dos sistemas de IA por nível de risco

Responsabilidade definida para decisões de IA

Revisões éticas e regulatórias regulares

Métricas de confiança (frequentemente negligenciadas):

Confiança do cliente e taxas de adoção

Frequência de queixas ou desafios ligada a decisões de IA

Resultados do envolvimento de reguladores ou auditores

As organizações que incorporam a governação cedo movem-se mais rapidamente ao longo do tempo porque reduzem retrabalhos, danos reputacionais e choques regulatórios.

Das métricas à maturidade

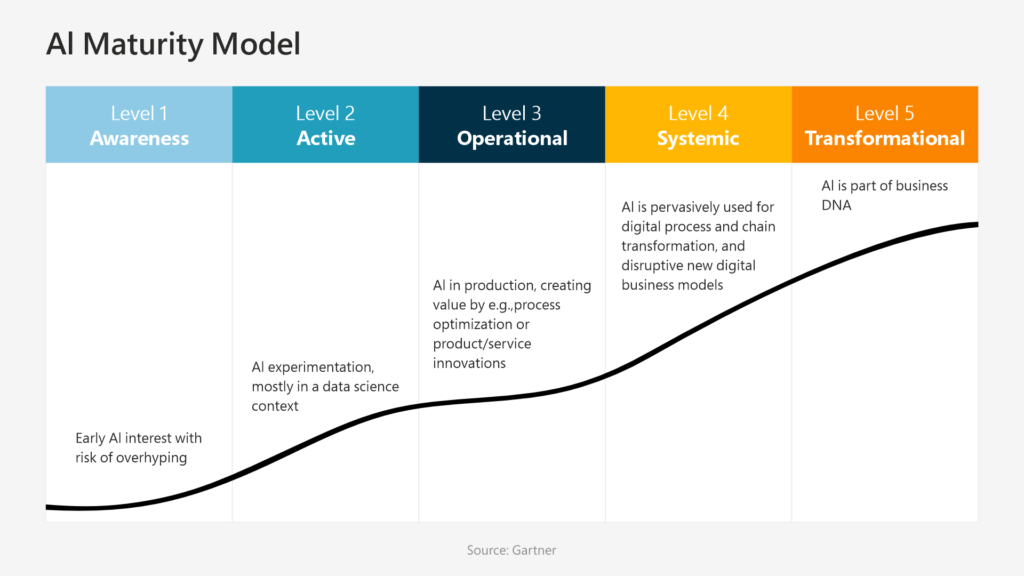

Estas métricas evoluem à medida que as organizações avançam nas fases de maturidade da IA:

Exploratório: Viabilidade técnica, consciência básica do risco

Formalizado: Acompanhamento de desempenho, quadros de governação

Incorporado: Monitorização contínua, garantia ética

Transformacional: A IA molda estratégias, padrões e normas do ecossistema

As organizações mais maduras tratam métricas responsáveis de IA como indicadores avançados, e não como controlos atrasados.

O que os líderes devem retirar

Uma transformação bem-sucedida da IA não é definida pelo número de modelos que implementa — mas por:

Se as decisões da IA podem ser explicadas, desafiadas e melhoradas

Se a criação de valor é acompanhada pela gestão responsável pelo risco

Se a confiança se acumula com o tempo em vez de se desgastar silenciosamente

IA responsável não é o oposto do desempenho. É a condição para um desempenho sustentável em larga escala.

Conclusão: Medir o que realmente importa

A transformação da IA obriga os líderes a repensar o que significa “sucesso”. Num mundo de sistemas adaptativos e escrutínio aprofundado, ética, governação e responsabilidade deixaram de ser extras opcionais — são métricas operacionais centrais.

Organizações que medem apenas velocidade e poupança podem mover-se rapidamente, mas raramente avançam longe. Aqueles que medem valor, confiança e responsabilidade juntos constroem sistemas de IA que duram.

Perguntas Frequentes

1. A IA responsável é mensurável?

Sim. Métricas que abrangem qualidade dos dados, cobertura de governança, explicabilidade, confiança e responsabilidade tornam a responsabilidade observável e acionável.

2. A IA responsável atrasa a inovação?

Na prática, acelera a escala sustentável ao reduzir o risco a jusante, a reformulação e a resistência.

3. Quem detém as métricas de governação da IA?

A partilha de propriedade entre as funções de liderança, produto, dados, jurídicas e éticas é essencial.